На технологическом фронте эволюция искусственного интеллекта (ИИ) продолжает стимулировать выдающиеся инновации. Тем не менее, он одновременно разворачивает повествование, наполненное опасениями по поводу вымирания человечества. Провидцы ИИ, такие как Сэм Альтман, глава OpenAI, и Джеффри Хинтон, общепризнанный «крестный отец» ИИ, четко сформулировали этот страх.

Раскрывая потенциальную катастрофу, открытое письмо Центра безопасности ИИ, поддержанное более чем 300 уважаемыми подписавшими, выявило экзистенциальную угрозу, которую представляет ИИ. Однако то, как это рукотворное чудо могло стать причиной гибели человечества, остается загадкой.

ИИ представляет угрозу исчезновения человечества

По словам Дэна Хендрикса, директора Центра безопасности ИИ, искусственный интеллект может открыть множество путей к рискам в масштабе общества. Злоупотребление ИИ злонамеренными сущностями представляет собой один из таких сценариев.

«Существует очень распространенное заблуждение, даже в ИИ-сообществе, что существует лишь горстка думеров. Но на самом деле многие люди в частном порядке выражали бы озабоченность по поводу этих вещей», — сказал Хендрикс.

Представьте себе злонамеренные силы, использующие ИИ для создания биологического оружия, смертоносность которого превосходит естественные пандемии. Другой пример — запуск мошеннического ИИ с намерением нанести массовый вред.

Если система ИИ наделена достаточным интеллектом или способностями, она может нанести ущерб всему обществу.

«Злоумышленники могут намеренно выпустить мошеннический ИИ, который активно пытается причинить вред человечеству», — добавил Хендрикс.

Тем не менее, это не только краткосрочная угроза, которая беспокоит экспертов. Поскольку ИИ проникает в различные аспекты экономики, передача контроля технологиям потенциально может привести к долгосрочным проблемам.

Эта зависимость от ИИ может сделать их «отключение» разрушительным и предположительно недостижимым. Следовательно, рискуя человечеством управлять своим будущим.

Неправильное использование и его далеко идущие последствия

Как предупредил Сэм Альтман, способность ИИ создавать убедительный текст, изображения и видео может привести к серьезным проблемам. Более того, он считает, что «если эта технология пойдет не так, она может пойти совсем не так».

Возьмем, к примеру, поддельное изображение мощного взрыва возле Пентагона, которое было распространено в социальных сетях. Это привело к временному спаду на фондовом рынке, так как многие учетные записи в социальных сетях, в том числе несколько проверенных, за считанные минуты распространили обманчивую фотографию, усилив беспорядок.

Такое неправильное использование ИИ указывает на способность технологии распространять дезинформацию и нарушать гармонию в обществе. Старший научный сотрудник Оксфордского института этики в области искусственного интеллекта Элизабет Реньерис заявила, что искусственный интеллект может «стимулировать экспоненциальное увеличение объема и распространения дезинформации, тем самым разрушая реальность и подрывая общественное доверие».

Еще одна тревожная тенденция — появление «галлюцинаторного» ИИ. Это тревожное явление, когда ИИ выдает ошибочную, но, казалось бы, правдоподобную информацию.

Этот недостаток, продемонстрированный в недавнем инциденте с ChatGPT, может поставить под сомнение доверие к компаниям, использующим ИИ, и еще больше увековечить распространение дезинформации.

Эрозия рабочих мест и взрыв неравенства

Стремительное внедрение ИИ в различных отраслях отбрасывает длинную тревожную тень на рынок труда. По мере развития технологий потенциальная ликвидация миллионов рабочих мест становится насущной проблемой.

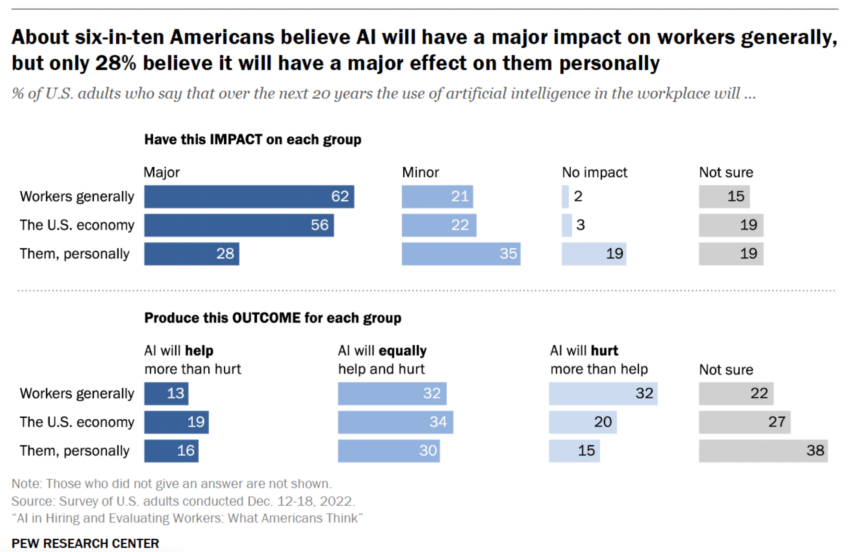

Недавнее , показало, что шесть из десяти американцев считают, что использование ИИ на рабочем месте значительно повлияет на работников в ближайшие 20 лет. Около 28% респондентов считают, что использование технологии повлияет на них лично, а еще 15% считают, что «ИИ больше навредит, чем поможет».

Всплеск автоматизированного принятия решений может способствовать усилению предвзятости, дискриминации и изоляции. Это также может способствовать созданию среды неравенства, особенно затрагивая тех, кто находится по ту сторону цифрового разрыва.

Более того, сдвиг в сторону зависимости от ИИ может привести к «ослаблению» человечества. Это может быть похоже на сценарий антиутопии в таких фильмах, как Wall-E.

Центр безопасности ИИ отметил, что господство ИИ может постепенно перейти под контроль ограниченного числа организаций. Это может позволить «режимам навязывать узкие ценности посредством повсеместного наблюдения и жесткой цензуры».

Это мрачное видение будущего подчеркивает потенциальные риски, связанные с ИИ, и подчеркивает необходимость строгого регулирования и контроля.

Призыв к регулированию ИИ

Серьезность этих опасений побудила лидеров отрасли выступать за ужесточение правил ИИ. Этот призыв к вмешательству правительства перекликается с растущим консенсусом в отношении того, что разработка и развертывание ИИ должны тщательно контролироваться, чтобы предотвратить неправомерное использование и непреднамеренное разрушение общества.

ИИ может быть благом или проклятием, в зависимости от того, как с ним обращаться. Крайне важно поддерживать глобальный диалог о снижении рисков и одновременном использовании преимуществ этой мощной технологии.

Премьер-министр Великобритании Риши Сунак утверждает, что искусственный интеллект сыграл важную роль в оказании помощи людям с параличом, чтобы они могли ходить и изобретали новые антибиотики. Тем не менее, крайне важно, чтобы эти процессы проводились надежно и безопасно.

«Люди будут обеспокоены сообщениями о том, что ИИ представляет экзистенциальные риски, такие как пандемии или ядерные войны. Я хочу, чтобы они были уверены, что правительство очень внимательно следит за этим», — сказал Сунак.

Управление ИИ должно стать глобальным приоритетом, чтобы он не стал угрозой для существования человечества. Чтобы использовать преимущества ИИ и снизить риски вымирания человечества, важно действовать осторожно и бдительно. Правительства также должны принять правила, способствовать глобальному сотрудничеству и инвестировать в тщательные исследования.

Отказ от ответственности

В соответствии с рекомендациями Trust Project в этой тематической статье представлены мнения и точки зрения отраслевых экспертов или отдельных лиц. BeInCrypto стремится к прозрачной отчетности, но взгляды, выраженные в этой статье, не обязательно отражают точку зрения BeInCrypto или ее сотрудников. Читатели должны самостоятельно проверять информацию и консультироваться со специалистом, прежде чем принимать решения на основе этого содержания.

Источник: https://beincrypto.com/artificial-intelligence-ai-risk-of-human-extinction/